Les contenus sont © P. Calmant et E. Depiereux - 2004; G. Vincke B. De Hertogh et E. Depiereux 2008.

Imprimé le

28/3/2026

Dans une population de chauves-souris, la totalité des individus peut être rangée dans des classes d'intervalles constants comme décrit précédemment dans les statistiques descriptives à une dimension.

La population est composée d'un grand nombre d'individus que l'on peut classer dans une infinité de classes d'intervalles Li tendant vers 0. L'histogramme est alors remplacé par une courbe de Gauss-Laplace:

Pour des échantillons de taille finie, l'ordonnée de l'histogramme se représente par des densités de fréquences relatives alors que pour la population on parle de densités de probabilités. (n tend vers l'infini et delta x tend vers 0)

| Equation et symbolique |

La distribution normale se caractérise par une équation faisant intervenir la moyenne µ et la variance σ2. Par convention, nous adopterons la convention d'écriture: X v.a.N(µ; σ2) . Dans la littérature, on peut aussi trouver: µ± σ ( moyenne ± écart-type).

| Symétrie autour de la moyenne |

La courbe de Gauss-Laplace est symétrique:

| Modification de la variance |

Lorsque la variance d'une population diminue, cela se traduit par une dispersion moins importante de la courbe autour de la moyenne. Concomitamment, le sommet de la courbe tend à s'élever afin de préserver une surface totale sous la courbe égale à 1 (ou 100%).

Exemple:Dans une population de chauves-souris de l'espèce A, l'envergure

X est une v.a. N(375; 225)

Dans une population de chauves-souris de l'espèce A femelles, l'envergure

X est une v.a. N(375; 121)

Dans une population de chauves-souris de l'espèce A femelles de

3 mois, l'envergure X est une v.a. N(375; 49)

etc.

| Influence de la variance sur le sommet

de la courbe de Gauss:

Si la variance diminue, le sommet de la courbe tend à augmenter. En effet, dans l'équation de la courbe, l'écart-type se trouve au dénominateur(voir terme entouré en rouge). Plus l'écart-type est petit, plus ce terme tend à devenir grand...

|

|

Chaque v.a. Normale possède

sa propre moyenne (µ) et variance (![]() 2).

Déterminer des probabilités sous ce type de courbes de Gauss

(à chaque cas particulier est associée une courbe de moyenne

et de variance particulière) requiert un algorithme d'intégration

numérique.

2).

Déterminer des probabilités sous ce type de courbes de Gauss

(à chaque cas particulier est associée une courbe de moyenne

et de variance particulière) requiert un algorithme d'intégration

numérique.

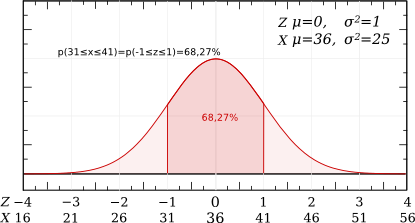

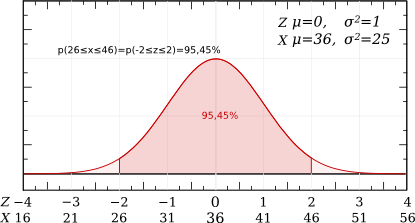

Heureusement, toutes les v.a. Normales peuvent se réduire à une seule et même distribution normale Z. La distribution réduite de Z est centrée sur une moyenne 0 et possède une variance 1. La table de probabilité de Z a été calculée une fois pour toutes et dispense des probabilités du type:

P(Z![]() zi)

zi)

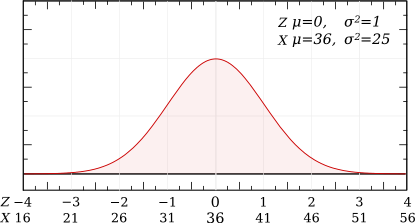

Toutes les distributions normales (v.a.N) peuvent être ramenées à une distribution obéissant aussi à la loi normale. Cette distribution est obtenue par la réduction de la variable étudiée X en une variable réduite appelée Z.

Cette distribution est centrée sur la moyenne 0 et possède une variance 1 et est symbolisée de la façon suivante:

Xobservé = 390 et X v.a.N (375;225)

alors Zobservé = (390-375)/(racine carrée de 225) = 15/15 = 1

Convertir une valeur réduite (Zobservé) en une valeur expérimentale (Xobservé)Zobservé = 2,5 et X v.a.N (375;225)

alors Xobservé = 2,5.(racine carrée de 225) + 375=412,5

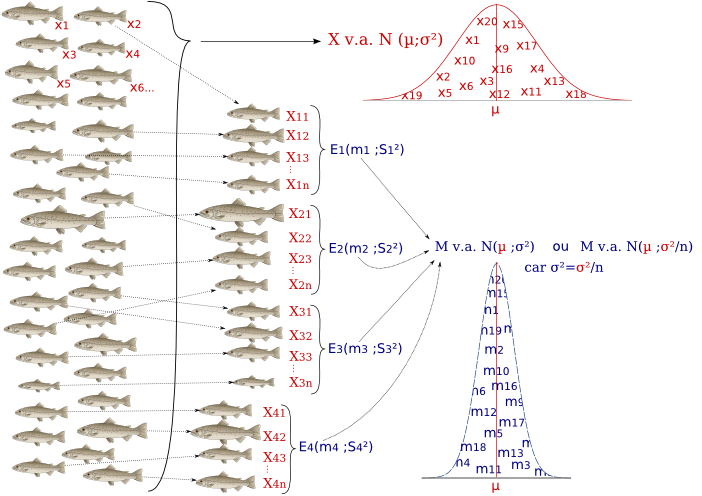

Le théorème central limite est un théorème mathématique qui explique les paramètres de la distribution d'échantillonnage, ou distribution des moyennes des échantillons.

Selon le théorème central limite, les moyennes des échantillons indépendants provenant d'une même population (µ;σ²) se distribuent elles aussi selon une distribution normale de paramètres (µ;σ²/n).

Soient x1, x2, x3 ... x∞ les tailles (cm) de truites arc-en-ciel. La taille de ces truites se distribue selon une distribution normale de paramètres :

X v.a. N(µ;σ²)

Si on réalise des échantillons indépendants (les poissons sont choisis au hasard) de n individus, toutes les moyennes de ces échantillons se distribuent selon une distribution normale de même moyenne, mais de variance plus faible, avec σ²moyennes = σ²individus / n.

Si les truites proviennent d'une population de paramètres (15;4), les échantillons de 4 truites auront des moyennes qui se distribuent selon un modèle Normal de paramètres (15;1).

Si les truites proviennent d'une population de paramètres (20;12), les échantillons de 3 truites auront des moyennes qui se distribuent selon un modèle Normal de paramètres (20;4).

etc...

Le théorème central limite s'applique aussi aux distributions discontinues telles que les distributions Binomiales ou de Poisson.

Prenons le cas du lancer d'un dé. Si le dé a 6 faces, et qu'il est équilibré, chaque face a 1/6ème de chance d'être affichée lors d'un lancer.

Si je lance le dé une seule fois, P(face=1)=P(face=3)=1/6

Si je lance le dé 10 fois P(moyenne=1)<P(moyenne=3)

Si je lance le dé 100 fois P(moyenne=1)<<<<<<P(moyenne=3)

etc...

Même si la variable est discontinue, la distribution des valeurs des moyennes des échantillons sera normale de paramètres (µ;σ²/n) avec µ=moyenne de la population des valeurs de départ, et σ² la variance de cette population de départ.

Lorsqu'on dispose des données de population (µ;σ²) et qu'on vous demande de calculer des probabilités associées à des valeurs moyennes réalisées sur n mesures, vous devez replacer ces valeurs moyennes dans leur distribution (µ;σ²/n) et non pas dans la distribution des valeurs des individus (µ;σ²).

La table de Z (accessible depuis le lien "Tables" en haut de toutes les pages de ce site) vous donne les probabilités associées à des valeurs de z selon la relation p(Z<z).

Exemple : quelle est la probabilité d'être inférieur à un z de 1,96 dans une distribution de z v.a. N(0;1) ?

La table vous donne la réponse :

En tête de ligne on trouve la valeur entière et la première décimale de la valeur z.

En tête de colonne on trouve la seconde décimale de z.

Donc P(Z<1,96)=0,975=97,5%

Inconvénient de la table de Z :

On peut la lire à l'envers donc par déduction on peut y trouver les valeurs de Z qui correspondent à une certaine probabilité.

Cependant toutes les probabilités intéressantes ne sont pas forcément représentées.

Si par exemple on cherche le z en dessous duquel il y a 98,5% des individus, on cherche la valeur 0,985 dans les valeurs du tableau, et en regardant les en-têtes de ligne et de colonne je trouve que le z qui correspond est 2,17 (ligne 2,1 et colonne 0,07).

Mais si je cherche le z tel que P(Z<z)=0,8=80%, il n'y a pas 0,8 dans les valeurs. On passe de 0,79955 à 0,80234, donc le z tel que P(Z<z)=0,8 est compris entre 0,84 et 0,85.

Cette table peut donc s'employer dans le sens :

z connu --> trouver la probabilité P(Z ≤ z)

ou dans le sens :

probabilité P(Z ≤ z) connue--> trouver le z correspondant, mais elle n'est pas pratique dans ce sens là.

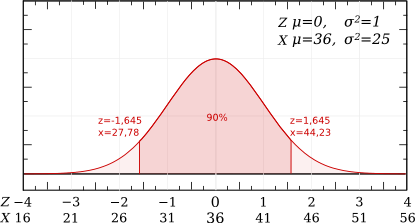

La table de Student part des probabilités et donne les valeurs des variables réduites correspondantes (z ou t).

Si la variance de la population est connue (σ2), on peut employer la table de t de Student comme s'il s'agissait d'une table simplifiée de Z.

L'avantage d'une telle table est de pouvoir donner rapidement des valeurs de Z ou des probabilités très couramment utilisées dans les tests d'hypothèses (voir l'emploi des intervalles de confiance).

Dans notre exemple précédent :

P(Z<z)=0,8=80% donne ici directement une valeur exacte de 0,842.

En conclusion :

Pour trouver une probabilité à partir d'une valeur de z : on utilise la table de Z.

Pour trouver une valeur de z à partir d'une probabilité : on utilise la table de student, dernière ligne.

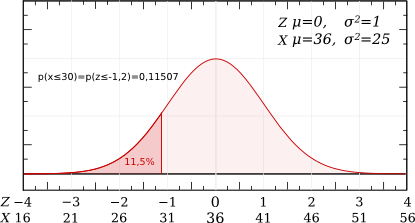

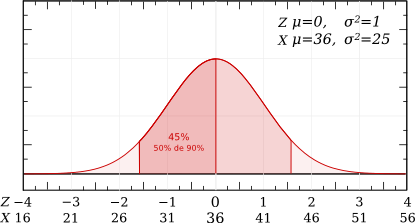

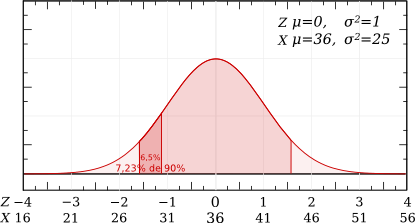

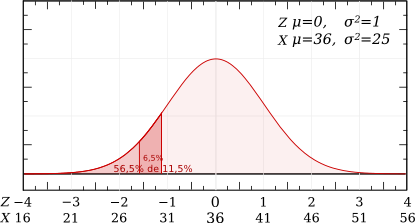

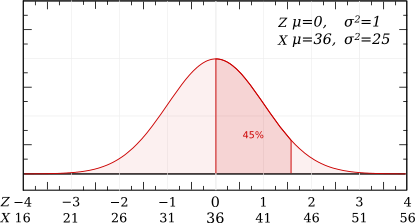

Une vache produit quotidiennement 36 ± 5 litres de lait.

Pour répondre vous devez consulter les tables.

Une vache produit quotidiennement 36 ± 5 litres de lait.

Correction :

Variable étudiée : la production quotidienne de lait chez la vache, mesurée en litres.

Paramètres : Moyenne : 36 l; Ecart-type : 5 l.

Retour à l'énoncé.

Correction :

Z=(30-36)/5=-6/5=-1,2.

La probabilité d'être inférieur à -1,2 correspond à celle d'être supérieur à 1,2 : p(Z≤-1,2)=p(Z≥1,2)

La probabilité d'être supérieur à 1,2 = 1 - Probabilité d'être inférieur à 1,2 : p(Z ≥ 1,2) = 1-p(Z≤1,2)

Dans les tables on trouve : Probabilité d'être inférieur à 1,2 = 0,88493.

Donc p(Z≤-1,2) = 1 - 0,88493 = 0,11507, c'est à dire 11,5%.

Retour à l'énoncé.